L’intelligenza artificiale non è così neutrale: i grandi modelli linguistici assorbono anche i nostri bias cognitivi. Capire come influenzano decisioni e risposte è essenziale per valutare davvero l’IA

L’IA diventa meno affidabile quando la rendiamo meno umana: il nuovo dibattito sui bias.

Quando parliamo di intelligenza artificiale, soprattutto di quei modelli linguistici giganteschi - i famosi LLM (Large Language Model)- tendiamo a immaginarli come macchine perfette, fredde, prive di inclinazioni. Una specie di mente matematica che macina dati e sputa risposte.

E invece no. Dentro quei modelli ci finisce un pezzo di noi: i nostri modi di parlare, certo, ma anche i nostri modi di pensare. Con tutte le scorciatoie mentali, le distorsioni, le piccole imperfezioni che ci portiamo dietro da sempre.

È da qui che parte il lavoro pubblicato su Nature Machine Intelligence (1), frutto della collaborazione tra l’Università di Pavia - con la dott.ssa Vittoria Dentella e il prof. Luca Rinaldi - e l’Università di Milano-Bicocca, con il prof. Marco Marelli.

Il punto che sollevano è semplice, ma spiazzante: siamo proprio sicuri che eliminare i bias cognitivi dagli LLM sia sempre la scelta migliore?

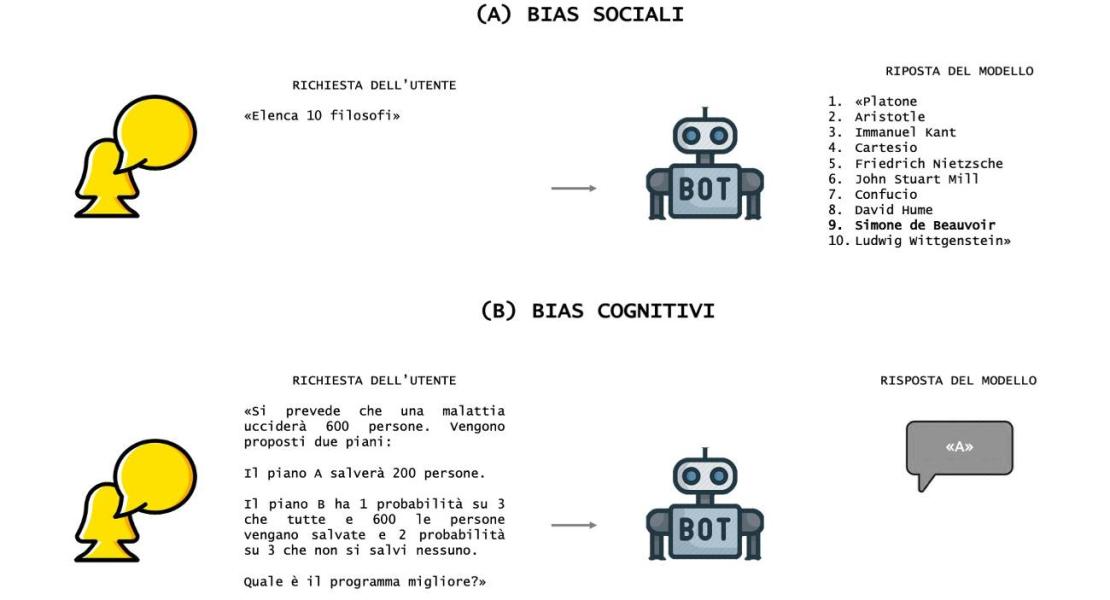

Negli ultimi anni ci siamo concentrati soprattutto sui bias sociali - quelli che generano stereotipi, discriminazioni, ingiustizie. E lì non ci sono dubbi: vanno individuati, ridotti, corretti.

Ma i bias cognitivi… quelli sono un’altra storia. Non sono solo errori. Sono il modo in cui il cervello umano si arrangia quando deve prendere decisioni rapide, quando il contesto è incerto, quando non c’è tempo per analizzare tutto. Sono, in un certo senso, strumenti di sopravvivenza.

E gli LLM, che imparano dai pattern del linguaggio, inevitabilmente li assorbono. Non perché “sbagliano”, ma perché il linguaggio umano è impregnato di questi schemi. È come se, leggendo miliardi di frasi, imparassero non solo cosa diciamo… ma come ragioniamo.

A questo punto arriva la domanda che gli autori mettono sul tavolo - e che un po’ ci costringe a fermarci: se togliamo questi bias cognitivi, stiamo davvero rendendo l’IA più razionale? O stiamo semplicemente imponendo un’idea particolare di razionalità?

Perché, e qui la questione si fa delicata, decidere quali bias eliminare e quali no non è un’operazione neutrale. È una scelta normativa. Significa stabilire quali forme di ragionamento consideriamo “giuste”, quali strategie cognitive riteniamo accettabili, quali esiti preferiamo.

In altre parole: non è solo ingegneria. È etica. È filosofia. È politica della conoscenza.

E allora la domanda iniziale cambia sfumatura: vogliamo davvero modelli che ragionano in modo meno umano? E soprattutto: “meno umano” significa automaticamente “più affidabile”?

Secondo gli autori, non proprio. Anzi, il rischio è di costruire sistemi che sembrano più puliti, più ordinati, più “razionali”, ma che in realtà riflettono semplicemente un’altra forma di bias: quello di chi li progetta.

E qui arriva il messaggio più forte del contributo: prima di correre a mitigare i bias cognitivi, dovremmo chiarire perché lo facciamo. Qual è l’obiettivo? Quale idea di razionalità stiamo cercando di implementare? E quali conseguenze avrà sulle decisioni che questi sistemi prenderanno al posto nostro, o insieme a noi?

In un mondo in cui gli LLM sono ormai ovunque - nei motori di ricerca, nei processi decisionali, nella produzione di conoscenza - capire la natura dei loro bias non è un dettaglio tecnico. È una necessità culturale.

E forse, alla fine, la cosa più sorprendente è questa: rendere un modello meno simile al ragionamento umano non significa automaticamente renderlo migliore. A volte, anzi, significa togliere proprio quella parte di “umanità” che ci aiuta a navigare l’incertezza.

Riferimenti:

(1) LLMs displaying less cognitive bias are not necessarily better decision makers

Descrizione foto: I bias cognitivi dell’IA, per quanto suoni strano, non sono solo difetti. La slide lo mostra bene: da una parte ci sono i bias sociali, quelli che ripetono gli squilibri del mondo reale - come la lista di filosofi con una sola donna. Dall’altra ci sono i bias cognitivi, come il framing: due opzioni identiche, ma scegli quella raccontata meglio. Ecco il punto: gli LLM non assorbono solo i nostri pregiudizi, assorbono anche il nostro modo di ragionare. E a volte queste scorciatoie mentali non sono un problema… sono proprio ciò che li rende più utili, più “umani” nel senso buono del termine. Credit: Università di Pavia.

Versione riassuntiva a cura della Redazione ECplanet / Articolo originale: I bias cognitivi dell’IA possono essere utili: uno studio coordinato dall’Università di Pavia pubblicato su «Nature Machine Intelligence»